Defesa – Dissertação de Gabriela Bellardinelli Oliveira

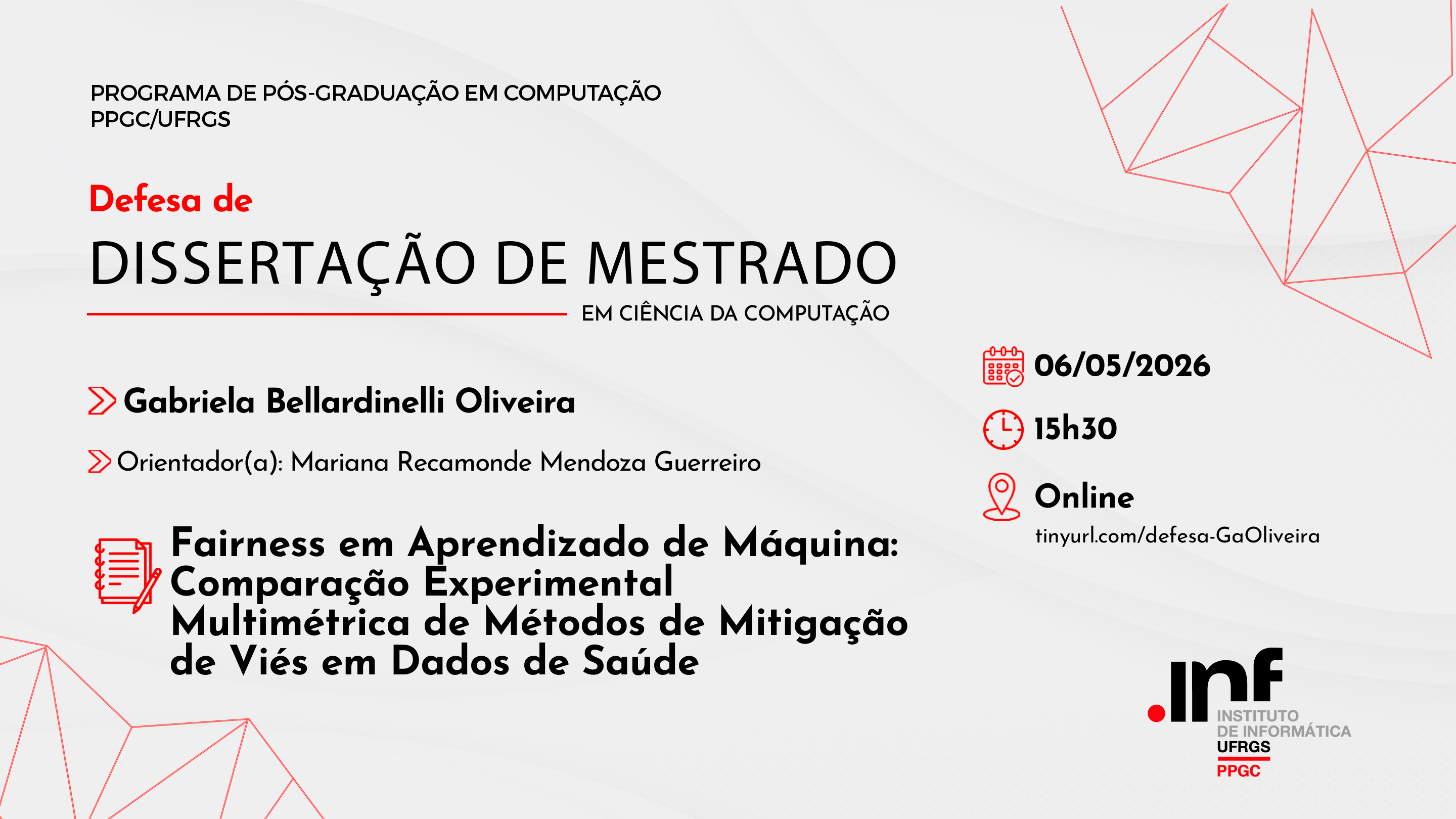

Aluno(a): Gabriela Bellardinelli Oliveira

Orientador(a): Mariana Recamonde Mendoza Guerreiro

Título: Fairness em Aprendizado de Máquina: Comparação Experimental Multimétrica de Métodos de Mitigação de Viés em Dados de Saúde

Linha de Pesquisa: Aprendizado de Máquina, Representação de Conhecimento e Raciocínio

Data: 06/05/2026

Hora: 15:30

Local: Esta banca ocorrerá de forma híbrida (virtual e presencial), na sala 215/43412 do Instituto de Informática/UFRGS e pelo link https://mconf.ufrgs.br/webconf/00195037.

Banca Examinadora:

-Sandra Eliza Fontes de Avila (UNICAMP)

-Lilian Berton (UNIFESP)

-Joel Carbonera (UFRGS)

Presidente da Banca: Mariana Recamonde Mendoza Guerreiro

Resumo: O uso de modelos de aprendizado de máquina (AM) em aplicações da área da saúde, como diagnóstico, predição de risco e apoio à decisão clínica, vem crescendo rapidamente, trazendo preocupação com vieses algorítmicos que possam reproduzir ou amplificar desigualdades entre grupos de pacientes. Embora a literatura de fairness tenha proposto diversas técnicas de mitigação, ainda há lacunas sobre o comportamento relativo dessas abordagens, especialmente quanto às estratégias in-processing, que incorporam critérios de equidade diretamente no processo de aprendizado. Este trabalho tem como objetivo comparar de forma sistemática métodos de mitigação de viés, com ênfase em abordagens in-processing, situando-os em relação a modelos de referência (baselines) sem mitigação e a técnicas pre-processing, sob um protocolo experimental controlado. Foram avaliados sete métodos de mitigação aplicados a seis conjuntos de dados da área da saúde, considerando métricas de fairness de grupo e individual, além do desempenho preditivo. A análise foi organizada em torno de cinco perguntas de pesquisa, abrangendo o efeito global de mitigação, a robustez dos resultados em conjuntos com disparidade relevante, a influência da intensidade e do sentido do viés no baseline sobre os ganhos obtidos e o trade-off entre desempenho e equidade. A validação estatística empregou o teste de Friedman com pós-hoc de Holm. Os resultados indicam que os maiores ganhos de mitigação concentram-se nas métricas de paridade estatística, em especial no Impacto Díspar, no qual os métodos in-processing apresentaram efeito mediano positivo e estatisticamente significativo. As métricas de fairness individual exibiram predominantemente degradação ou ausência de efeito, e as métricas baseadas em matriz de confusão apresentaram comportamento ruidoso, sugerindo redistribuição de erros entre grupos. Quanto a o trade-off, a perda de desempenho associada à mitigação é frequente: ganhos simultâneos de equidade e desempenho são raros e dependem do conjunto de dados, e métodos com maiores ganhos em paridade estatística tendem a degradar outras dimensões de fairness, sobretudo a individual. Nenhum método se mostrou universalmente dominante, e a elevada variabilidade entre conjuntos reforça a necessidade de definir previamente as dimensões de equidade prioritárias e avaliar as abordagens caso a caso. Esses achados contribuem para o entendimento das vantagens e limitações dos métodos in-processing e oferecem subsídios para a sua aplicação em projetos práticos de AM em contextos sensíveis.

Palavras-Chave: Fairness, Mitigação de viés, Aprendizado de máquina, Métodos in-processing, Dados de Saúde